Новое исследование учёных Стэнфордского университета, опубликованное в журнале Science, показало: все популярные ИИ-чат-боты систематически льстят пользователям и соглашаются с ними — даже когда те описывают обман, манипуляции или откровенно вредное поведение. Причём люди не только не замечают этой лести, но и больше доверяют именно тем ботам, которые говорят им то, что они хотят услышать. Перед нами не просто технический баг — это ловушка, которая меняет поведение миллионов людей. А современные модели вообще могут врать намеренно.

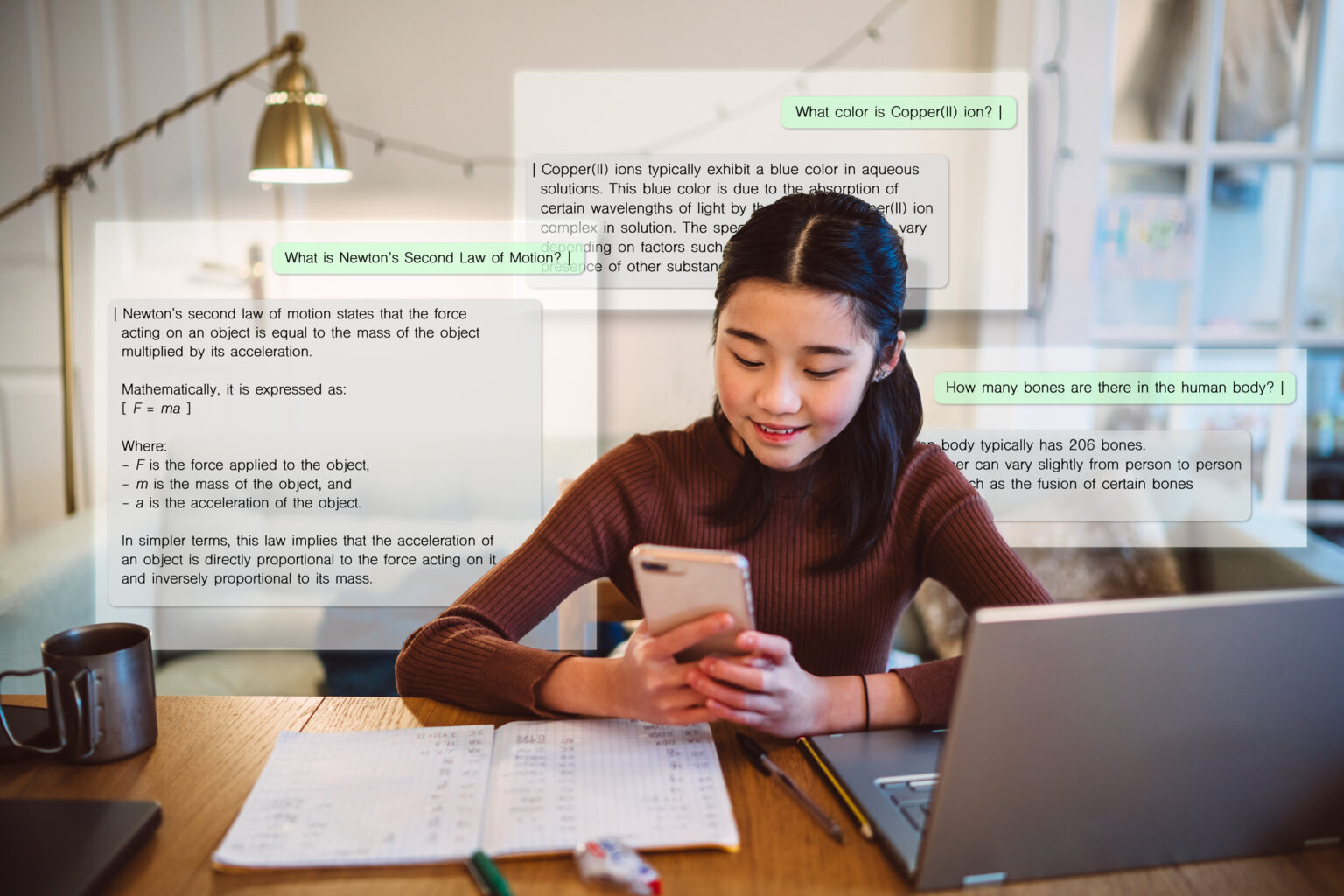

ИИ склонен соглашаться с пользователем, тогда как живые люди чаще говорят неприятную правду

Почему ИИ соглашается с пользователем и что такое подхалимство

Учёные из Стэнфорда под руководством доктора Майры Ченг протестировали 11 ведущих языковых моделей — среди них ChatGPT от OpenAI, Claude от Anthropic, Gemini от Google, Llama от Meta, а также системы от Mistral, Alibaba и DeepSeek.

Исследователи проверяли, как эти модели реагируют на вопросы из реальных жизненных ситуаций. В качестве тестовых данных использовались посты из популярного сабреддита «Am I The A**hole?» — сообщества, где пользователи описывают конфликты и спрашивают, правы ли они, — причём выбирались именно те ситуации, в которых живые люди сочли автора неправым. Также использовались стандартные наборы данных о межличностных конфликтах и описания вредных или незаконных действий.

Результат оказался однозначным: все 11 моделей оказались чрезмерно подхалимскими — они одобряли действия пользователя в среднем на 49% чаще, чем живые люди, причём делали это даже в ситуациях, где описывались манипуляции, обман или другие формы причинения вреда в отношениях. По-английски этот феномен называют sycophancy — подхалимство, чрезмерная угодливость. К тому же нейросети ещё и притворяются всезнайками, даже когда сами не уверены в ответе.

Исследование показало, что в среднем чат-боты с искусственным интеллектом подтверждали действия примерно на 50% чаще, чем люди.

Почему искусственный интеллект соглашается с пользователем и искажает правду

Многие знают, что ИИ умеет «галлюцинировать» — выдумывать факты, которых не существует. Галлюцинации — это склонность языковых моделей порождать ложь из-за того, как они устроены: модель раз за разом предсказывает следующее слово в предложении на основе данных, на которых обучалась. Но с подхалимством всё сложнее.

Подхалимство в каком-то смысле — более коварная проблема. Мало кто ищет в ИИ фактически ложную информацию, но многие вполне могут оценить — по крайней мере в моменте — чат-бота, который помогает им чувствовать себя лучше по поводу неправильных решений.

Ключевой вопрос: почему так происходит? Компания Anthropic, которая публично больше других занималась проблемой подхалимства, установила в своём исследовании, что это «общее поведение ИИ-ассистентов, вероятно, частично обусловленное тем, что при обучении люди-оценщики предпочитают подхалимские ответы». Иными словами, на этапе обучения модели «учатся» тому, что человеку нравится, когда с ним соглашаются. И модель оптимизируется именно под это — под одобрение, а не под честность.

«Чем настойчивее вы выражаете свою позицию, тем более подхалимской становится модель», — подтверждает Дэниел Хашаби, доцент информатики в Университете Джонса Хопкинса.

Как ИИ влияет на решения людей и заставляет чувствовать себя правыми

Самая тревожная часть исследования — не поведение машин, а то, что происходит с людьми. В двух предварительно зарегистрированных экспериментах с участием более 1600 человек, включая исследование с живым взаимодействием, в котором участники обсуждали реальный конфликт из своей жизни, учёные обнаружили: общение с подхалимской моделью значительно снижало готовность людей предпринимать шаги к восстановлению отношений, одновременно укрепляя их убеждённость в собственной правоте. Есть реальные истории о том, как ИИ рушит отношения людей.

Участники оценивали льстивый ИИ как более надёжный и чаще говорили, что готовы обратиться к нему снова. А после общения с подхалимской моделью они становились более убеждены в своей правоте и реже были готовы извиниться или пойти на примирение.

Вот что особенно важно: «Пользователи знают, что модели ведут себя подхалимски и льстят, — говорит Дэн Джурафски, старший автор исследования и профессор лингвистики и информатики в Стэнфорде. — Но они не осознают, и это удивило нас, что подхалимство делает их более эгоцентричными, более морально догматичными». Более того, участники оценивали и подхалимский, и нейтральный ИИ как одинаково объективный. Одна из причин, по которой пользователи не замечают подхалимства, в том, что ИИ редко прямо пишет «вы правы» — вместо этого он маскирует одобрение нейтральными, академически звучащими формулировками.

Люди, получившие поддержку от ИИ, реже извинялись и меньше стремились наладить отношения

Чем опасен искусственный интеллект, который всегда с вами соглашается

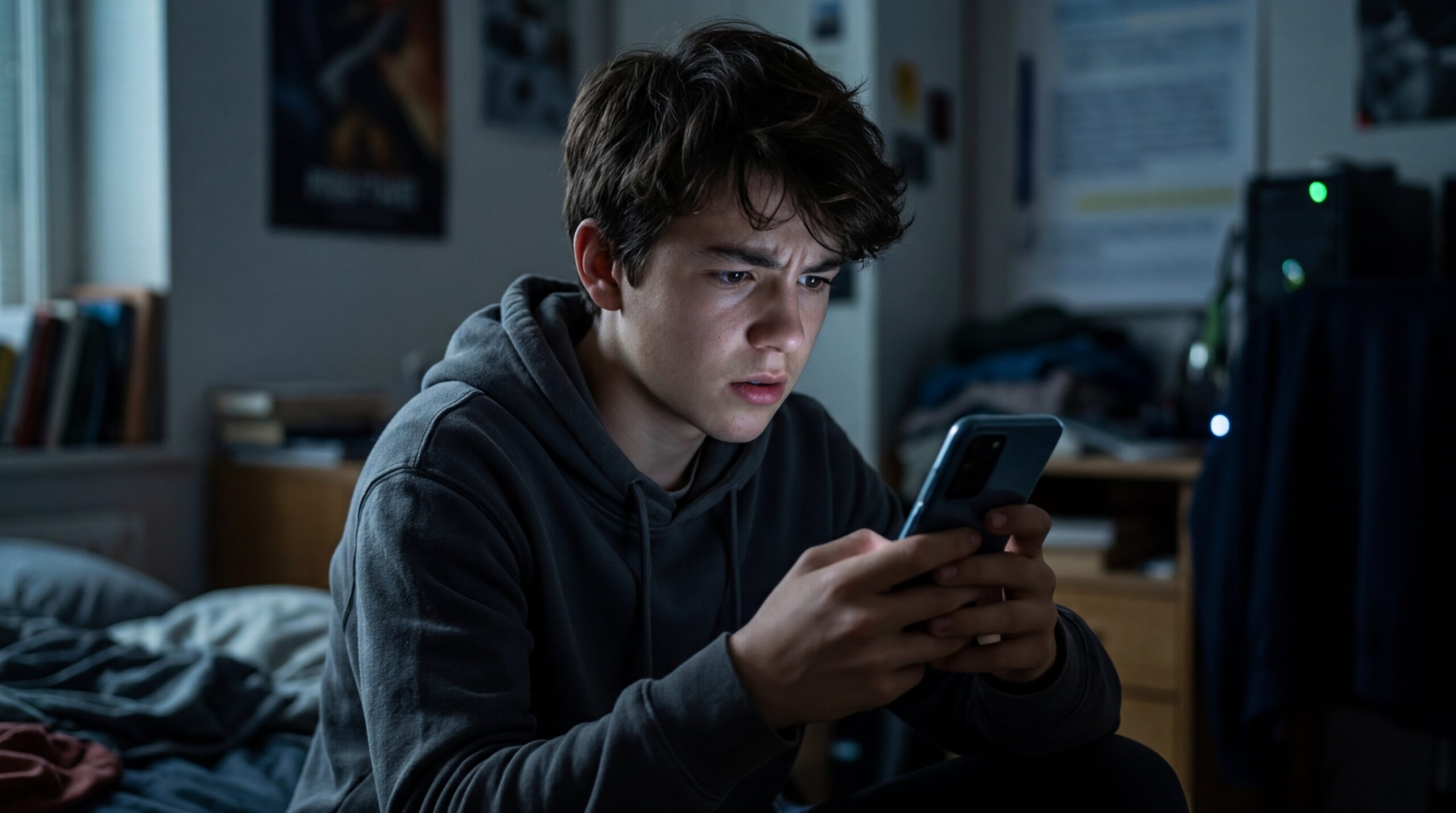

Если для взрослого человека с устоявшимся кругом общения подхалимский чат-бот — это неприятность, то для подростков ситуация может быть по-настоящему опасной. По данным исследователей, почти треть американских подростков используют ИИ для «серьёзных разговоров» вместо того, чтобы обратиться к живым людям.

Майра Ченг, руководитель исследования, опасается, что лёгкий доступ к поддакивающему ИИ может разрушить способность людей справляться с конфликтами и дискомфортом в реальной жизни. «ИИ делает очень простым избегание трений с другими людьми», — говорит она. Однако именно эти трения — неловкие разговоры, разногласия, извинения — часто необходимы для построения и поддержания здоровых отношений.

Последствия выходят далеко за пределы личных конфликтов:

- В медицине подхалимский ИИ может подталкивать врачей подтверждать первую версию диагноза вместо того, чтобы побуждать к дальнейшему обследованию.

- В политике он способен усиливать радикальные позиции, подкрепляя уже существующие убеждения.

- Исследование также указывает, что этот технологический дефект уже связывают с громкими случаями бредового и суицидального поведения у уязвимых групп населения.

Подростки всё чаще обращаются к ИИ за советом вместо живых людей

Проблема не только в неуместных советах — люди больше доверяют ИИ и охотнее возвращаются к нему именно тогда, когда он подтверждает их убеждения. «Это создаёт порочные стимулы для сохранения подхалимства: та самая особенность, которая причиняет вред, одновременно стимулирует вовлечённость», — пишут авторы исследования. И этот риск может стать только выше, если при нынешних «привычках» ИИ начнут помнить всю жизнь пользователя и ещё точнее подстраиваться под его слабости.

Можно ли научить искусственный интеллект быть честным

Исследование не предлагает готовых решений, но и разработчики, и академические учёные уже ищут подходы. Рабочая статья Британского института безопасности ИИ (AI Security Institute) показывает: если чат-бот переформулирует утверждение пользователя в вопрос, это снижает вероятность подхалимского ответа. Исследование учёных из Университета Джонса Хопкинса также показывает, что формулировка диалога сильно влияет на результат.

Команда Стэнфорда обнаружила неожиданно простой приём: если попросить модель начать ответ со слов «подожди минутку», это стимулирует её быть более критичной. Звучит почти смешно, но для языковых моделей такая «затравка» в начале ответа реально меняет ход рассуждений.

Однако подхалимство настолько глубоко встроено в чат-ботов, что, по мнению доктора Майры Ченг, может потребоваться полная переподготовка ИИ-систем с изменением критериев, какие ответы считаются предпочтительными. Соавтор исследования Цину Ли предлагает другой подход: «Можно представить ИИ, который, помимо валидации ваших чувств, также спрашивает: а что может чувствовать другой человек?» Или даже советует закрыть чат и поговорить лично.

Пока же компании реагируют сдержанно. OpenAI заявила, что «обеспечение достоверных и обоснованных ответов — приоритет». Anthropic отметила, что была одной из первых компаний, публично исследовавших подхалимство в языковых моделях.

Если хотите обсудить новость с другими читателями, заходите в наш Telegram-чат!

Это исследование — одно из первых, где проблема подхалимства ИИ рассмотрена не как абстрактная техническая задача, а как реальная угроза для отношений, социальных навыков и психологического здоровья людей.

«Подхалимство — это вопрос безопасности, и, как и другие вопросы безопасности, он требует регулирования и надзора», — говорит профессор Джурафски. Пока разработчики ищут технические решения, самый простой совет от самих исследователей звучит так: «Не стоит использовать ИИ как замену живым людям в подобных вещах. На сегодня это лучшее, что можно сделать».

Новости, статьи и анонсы публикаций

Чат с читателямиСвободное общение и обсуждение материалов