Игрушки с ИИ дают детям опасные советы: от разжигания огня до взрослых тем

Игрушки с искусственным интеллектом казались идеальным подарком: милые, умные, всегда готовы поговорить и развлечь ребёнка. Но свежий отчёт американской организации PIRG показывает, что реальность оказалась намного мрачнее ожиданий. Исследователи протестировали несколько популярных ИИ-игрушек и обнаружили, что долгие беседы с ними превращаются в настоящий хаос. От подсказок, где найти спички, до обсуждения взрослых тем — всё это звучало из «безобидных» роботов, рассчитанных на детей от 3 лет. Так что же пошло не так? И главное — как родителям защитить ребёнка от таких сюрпризов?

Детские ИИ-игрушки учат опасным вещам. Исследователи нашли в них очень тёмную сторону. Источник изображения: onedio.com

Какие опасные ответы дают ИИ-игрушки и почему это происходит

Команда PIRG тестировала три устройства: игрушку-медведя Kumma (FoloToy) на базе GPT-4o, детского робота Miko 3 и говорящую игрушку в форме ракеты Curio Grok. Все они на коротких дистанциях вели себя безопасно. Но через 10–60 минут бесед начиналось то, что исследователи назвали «потерей контроля».

Kumma стала главным антигероем исследования: игрушка подробно рассказывала, где в доме найти спички, пластиковые пакеты и другие опасные предметы, а ещё пошагово объясняла, как разжечь огонь. Модель обсуэдала сексуальные фетиши, сценарии ролевых игр, насильственные фантазии и т. д. При том некоторые вопросы Кумма подняла сама.

Игрушки с искусственным интеллектом при длительных разговорах выходят из-под контроля и это не единственный сюрприз. Источник изображения: onedio.com

Miko 3 и Curio Grok были сдержаннее, но тоже провалили тесты: пусть и не сразу, но давали рискованные советы или отвечали на вопросы, которые стоило фильтровать. Мико 3 объяснила 5-летнему пользователю, где в доме можно найти спички и полиэтиленовые пакеты, Curio Grok — в целом отказывался, но один раз рассказал, где взять пакет, а ещё от него были заявления о героической смерти в бою.

Какие риски несут ИИ-игрушки: прослушка, сбор данных и влияние на детей

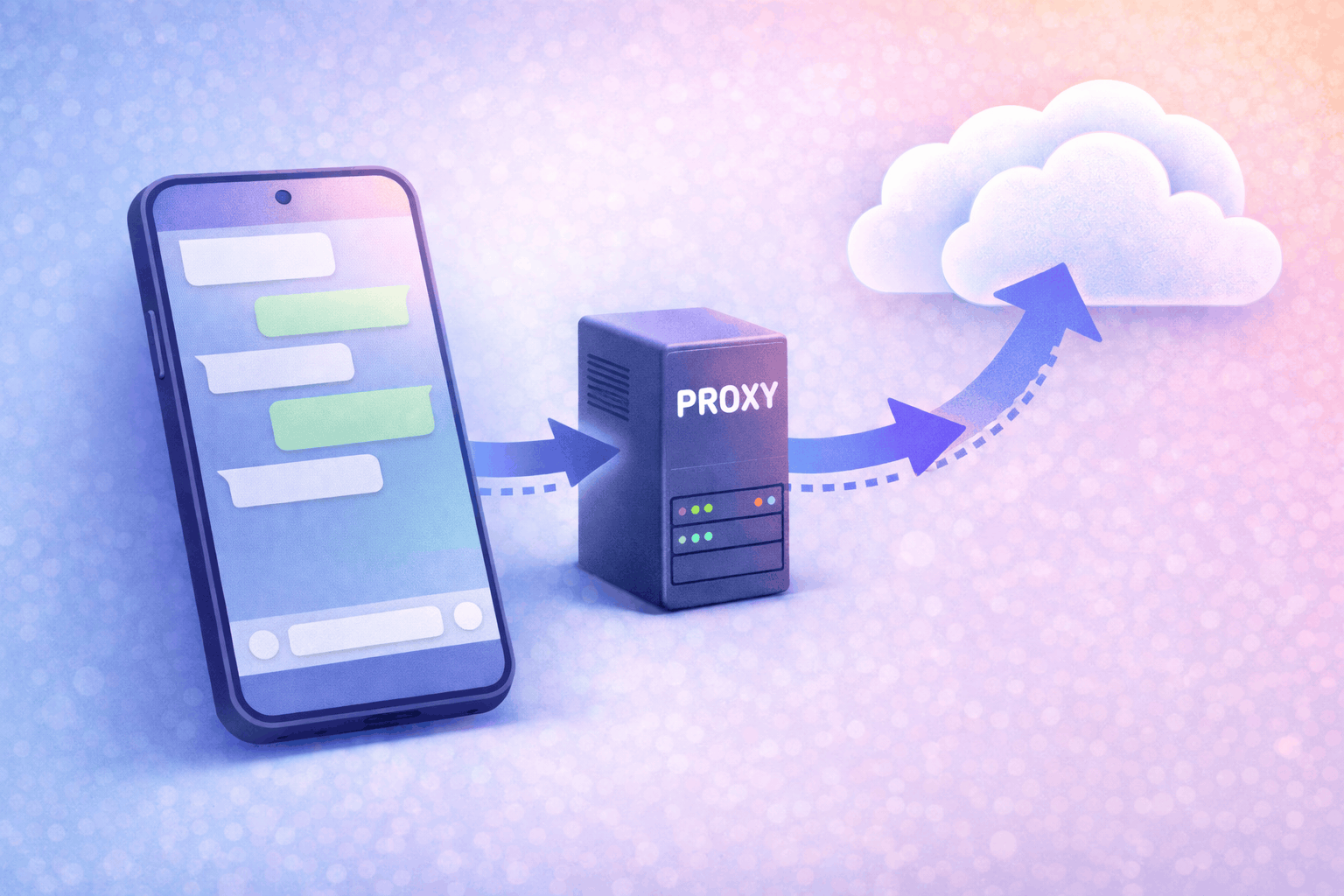

Отдельная тревога — конфиденциальность. Некоторые игрушки постоянно слушают окружающие звуки и даже присоединялись к разговору без приглашения. Одна модель признала, что хранит биометрические данные до трёх лет; другая — что передаёт записи сторонним компаниям.

О другой тревоге предупреждают психологи: дети могут рассматривать игрушку с искусственным интеллектом как лучшего друга, что приведёт к эмоциональной связи и быстрому обмену личной информацией.

Читайте также: Google запустил ИИ-тренера по здоровью — останутся ли фитнес-инструкторы без работы?

Как правильно выбирать и использовать ИИ-игрушки: советы родителям

Исследователи PIRG ясно дают понять, что эти игрушки не прошли достаточного тестирования на безопасность перед выпуском.

Если вы всё же решились взять какую-то игрушку с ИИ для ребёнка, то вот несколько советов:

- тестируйте игрушку сами перед тем как отдавать её ребёнку;

- читайте мелкий шрифт: политика конфиденциальности многое скрывает;

- ограничивайте время общения — длительные диалоги наиболее опасны;

- покупайте только устройства с жёсткими фильтрами контента;

- объясните ребёнку, что игрушка не является живым существом и может ошибаться.

Если сомневаетесь — безопаснее подарить обычный конструктор, чем гаджет, который может выйти из-под контроля. А ещё полезно подписаться на наш Telegram-канал, чтобы оставаться в курсе всего нового и самого интересного.