С тех пор как фильм «Метрополис» 1927 года познакомил зрителей с первым кинематографическим злым роботом (женского пола, причем), общество отреагировало на совокупный приход идей искусственного интеллекта, роботов и других интеллектуальных систем смесью удивления и чистого ужаса. Компьютерные ученые работают над тем, чтобы свести эти страхи на нет путем введения «морали» в машины или дружелюбный искусственный интеллект.

Тем не менее основной недостаток этих усилий в том, что они признают, что проблема заключается в этой технологии — а не в нашей эмоциональной человеческой реакции на нее. Адаптация к сложности «второй машинной эпохи» требует понять наш страх, а не поддаваться ему. К сожалению, наша собственная тенденция предаваться раздутым слухами страхам может пошатнуть нашу собственную автономию в мире, который в значительной мере будет определяться автономными машинами.

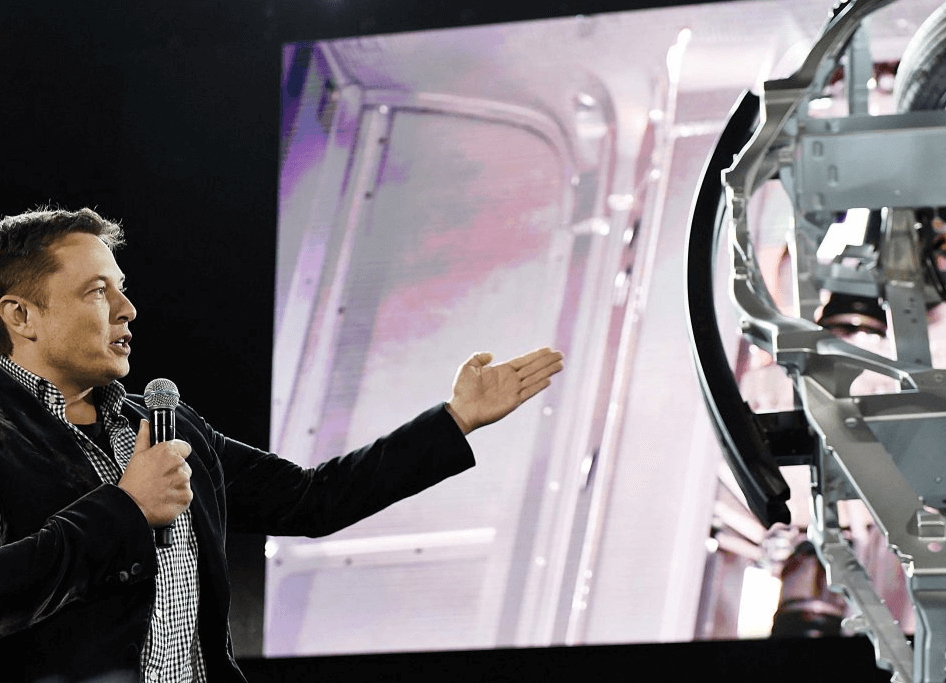

Генеральный директор Tesla и известный новатор Элон Маск неоднократно предупреждал об угрозах искусственного интеллекта. В июне в интервью CNBC он заявил, что инвестировал в исследования искусственного интеллекта только потому, «что хочет пристально следить за тем, что происходит с ним». Он видит в ИИ грандиозную опасность. Терминатора или что похуже.

В августе он написал, что «нам нужно быть сверхосторожными с искусственным интеллектом. Его потенциал опаснее ядерных ракет». На недавнем симпозиуме в MIT Маск окрестил ИИ «экзистенциальной угрозой» для человеческой расы и «демоном», которого глупые ученые и технологи «пытаются призвать».

Маск сравнил мысль о том, что мы сможем управлять этой силой, с «парнем с пентаграммой и святой водой», который уверен в том, что обуздает сверхъестественную силу — пока она не пожрет его. Сам Маск предполагает, что решение этой проблемы лежит в трезвом и взвешенном сотрудничестве между учеными и политиками. Правда, непонятно, как рассуждения о «демонах» помогают его благородной цели. На самом деле, они только мешают этому.

Для начала отметим, что в сценарии Skynet зияют огромные бреши. Хотя ученые не считают, что Маск «окончательно спятил», они все еще очень далеки от мира, в котором вообще возможен сценарий возникновения такого искусственного интеллекта.

Ян Лекун, глава лаборатории искусственного интеллекта Facebook, суммировал шумиху 2013 года так:

«Шумиха опасна для ИИ. Шумиха убила искусственный интеллект четыре раза за последние пятьдесят лет. Шумиху нужно остановить. Забудьте о Терминаторе. Нам нужно тщательно взвешивать все, что мы говорим о ИИ. По сути, наш самый «умный» ИИ по развитию эквивалентен младенцу. Большинство робототехников до сих пор пытаются научить робота поднимать мяч или бегать, не падая, а не наносят последние штрихи в деле Skynet».

Лекун и другие правы относительно последствий шумихи. Несоответствие ожиданиям, выросшим на фоне научной фантастики, как правило, часто приводило к суровым сокращениям финансирования исследований в сфере ИИ. Но это не единственный риск, к которому могут привести рассуждения Маска о сверхъестественном (не искусственном) интеллекте.

Специалист по законам и политике технологий Адам Тирер разработал теорию того, что сам он называет «технопаникой» — моральной паникой на фоне расплывчатой нависшей технологической угрозы, приводимой в действие иррациональной и склонной к преувеличению толпой, а не реальной оценкой угрозы. К примеру, вместо качественных обсуждений проблем кибербезопасности американские СМИ трубят о «кибернетическом Перл-Харборе», который уничтожает информационную инфраструктуру Америки. Отметим, что проблема кибербезопасности набирает обороты в США.

Никто не берет в голову, что разрушительное воздействие Stuxnet было раздутым. Всем наплевать на более приземленные, но не менее серьезные вопросы об ошибках, которые существуют в программном обеспечении с открытым исходным кодом вроде OpenSSL и UNIX Bash.

Тирер диагностирует шесть факторов, которые вызывают технопанику: разница между поколениями, которая вызывает боязнь нового; «гиперностальгия» по иллюзорным старым добрым временам; экономический стимул для СМИ на основе спекулирования слухами; моральные и культурные дебаты о новых технологиях; элитарные и пренебрежительные настроения среди академических скептиков и критика культуры новых технологий и инструментов, одобренных массовой публикой. Все эти аспекты представляют совершенно разумное объяснение, но есть и седьмой фактор: психологические последствия зависимости человека от сложных технологий почти в каждой сфере современной жизни.

Как утверждают техносоциологи, мы зависим от технологий, которые сами не можем понять или контролировать. Мы вынуждены доверять тому, что эти системы и подсистемы, от которых мы зависим, и эксперты, которые их поддерживают, работают так, как заявлено. Пассажиры могут иметь смутное представление о физике полета, но не о формулах, которые используются для расчета механики удержания самолета в воздухе.

Более того, ни один инженер из команды проектировщиков не обладает полным знанием каждого компонента. Сложные, но крайне важные технологии вроде самолетов всегда чужды и загадочны для нас. В отличие от «Звездного пути», для многих пользователей их iPhone и iPad представляют собой «о дивный новый мир».

В этом свете знаменитая цитата Артура Кларка о том, что передовые технологии «неотличимы от магии», объясняет, почему Маск обратился к оккультной образности, более характерной какой-нибудь Баффи, которая истребляла вампиров, нежели Стюарту Расселлу и Питеру Норвигу. Современные технологии для нас — это своего рода черная магия, окутанная мистикой; в наше время колдуны используют C++ и Java вместо пентаграмм и святой воды.

Риторика Маска не является безвредной. Страх перед беспилотниками уже привел к драконовским ограничениям деятельности неправительственных дронов и прочих похожих воздухоплавательных средств; такие решения душат инновации. Как отмечал техносоциолог Шон Лоусон, Федеральное управление гражданское авиации не разрешало добровольцам использовать дронов для поиска пропавших людей и даже ругалось с новостным агентством, которое опубликовало кадры, снятые с помощью беспилотного дрона.

Хотя Маск надеется, что его опасение заставит шевелиться международные и локальные органы, трудно представить, что на деле оно только приведет к разгильдяйским ограничениям вроде тех, о которых говорил Лоусон. Самое серьезное негативное влияние от страшных слухов на тему ИИ заключается не в нормативной сфере. Оно может хорошо укрепить и ухудшить отношение среднестатистического человека к новым технологиям и зависимости от них.

В лучшем случае компьютерные технологии станут необходимой рутиной для многих пользователей. В худшем — компьютерные технологии будут вызывать недоумение и отчуждение, иногда требовать вмешательства технических специалистов с тайными базами знаний.

Технопаника не создает разрыв между массами, далеких от Linux, и отрядом любителей пособирать ядро — но точно ухудшает. Когда публичные фигуры вроде Маска характеризуют новые технологии загадочными, паническими и метафорическими терминами, они пускают под откос суеверия и невежества ту же науку, благодаря которой появились автомобили Tesla.

Вместо того, чтобы помочь пользователям адаптироваться и даже подготовить их к тому, что робот в белом воротничке может присоединиться к ним за рабочим местом, Маск воодушевляет бояться и презирать всего, что мы не понимаем. Собирайтесь, мужики, берите вилы, пойдем к демону в высокой башне. Трагедия нарастающей технопаники вокруг ИИ в том, что однажды она может уменьшить значимость человека в мире, которым будут управлять машины. Мы знаем, что развитие ИИ должно принципиально изменить все сферы нашей жизни, от романтических взаимоотношений до национальной безопасности.

Возможно, все не так, поскольку ИИ, к сожалению, уже был не в состоянии оправдать наши ожидания. Но разве было бы в интересах обществах — через видение демонов, волшебников и колдунов — наращивать разрыв между технологами, которые делают самоуправляемые автомобили, и остальными — которые будут на них ездить?

Дебаты вокруг ИИ и общественной политики часто пытаются точно описать, что представляет собой машинная автономия, но вам не нужно быть семи пядей во лбу, чтобы понимать, что такое быть автономным человеком, взаимодействующим с машиной. Это понимание (по крайней мере на определенном уровне) и наша способность принимать уверенные решения лежат в основе нашего повседневного использования технологий. Если бы пользователи брали на себя больше ответственности и пытались понять технологии, им не пришлось бы обращаться в сервисные центры или какие-нибудь Genius Bar. Маск прав в том, что ИИ нельзя оставлять чистым программистам. Но опасения того, что ИИ может превратиться в Skynet, только приводят к «цифровому разрыву» между теми, кто разбирается в технологиях, и теми, кто не разбирается.

Если Маск перенаправит свою энергию и поможет нам всем понимать и управлять интеллектуальными системами, он приблизит тот день, когда технологическое будущее будет всем хорошо понятно и значимо для всех. В конце концов, ИИ для масс не будет колонизацией Марса или Hyperloop. Он будет значительно более социальным и полезным для общества — идти ему навстречу важнее, чем препятствовать его развитию и отдаляться от него.

Новости, статьи и анонсы публикаций

Чат с читателямиСвободное общение и обсуждение материалов