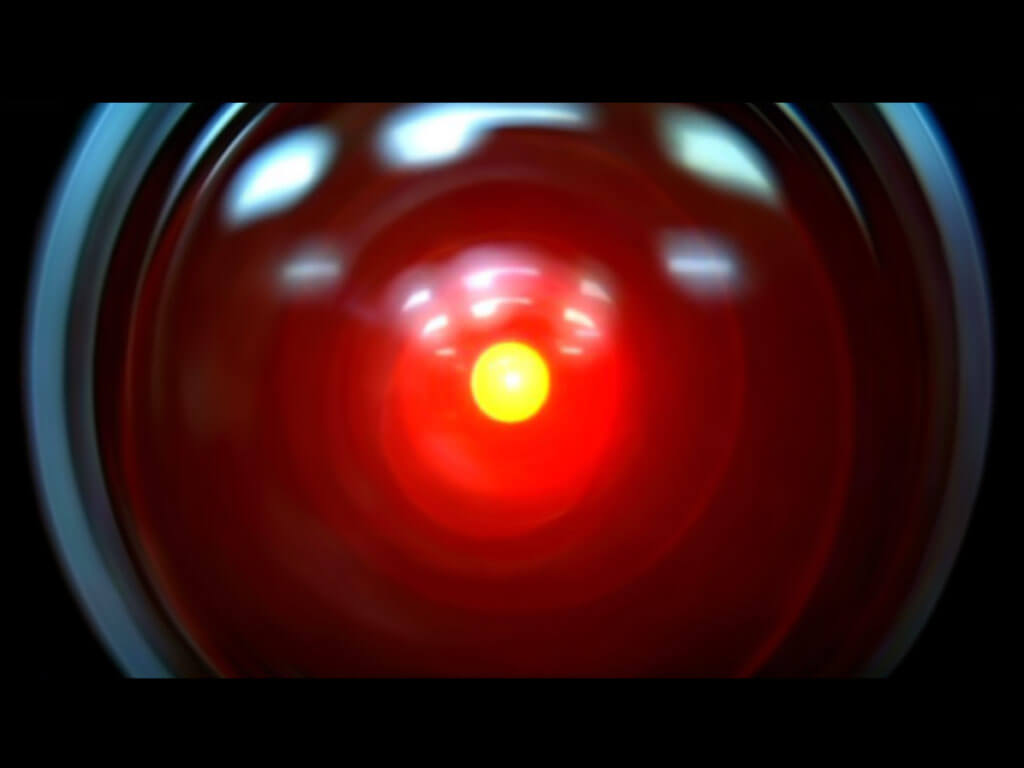

Темпы развития искусственного интеллекта растут с каждым годом. В связи с этим, сотни ведущих ученых и предпринимателей мира призывают нас вновь обратить внимание на безопасность и этику, связанные с этой сферой, чтобы предотвратить всякую угрозу для общества.

Открытое письмо было подписано известным физиком Стивеном Хокингом, соучредителем Skype Яаном Таллинном, генеральным директором SpaceX Элоном Маском и другими светилами науки из лучших университетов мира: Гарвардского, Стэнфордского, Массачусетского, Кэмбриджского, Оксфордского; также к письму присоединились такие компании, как Google, Microsoft и IBM.

«Исследования искусственного интеллекта были посвящены целому ряду проблем и подходов с момента появления [дискурса], но за последние 20 или около того лет они сосредоточились вокруг построения интеллектуальных агентов — систем, которые воспринимают и действуют в определенной среде. В этом контексте «интеллект» относится к статистическим и экономическим понятиям рациональности — проще говоря, способности принимать правильные решения, составлять планы и делать выводы.

Принятие вероятностных, теоретических представлений, решений и статистических методов обучения привели к значительной интеграции и взаимному обогащению искусственного интеллекта (AI), машинного обучения, статистики, теории управления, неврологии и других областей. Создание общих теоретических основ, рамок в сочетании с доступностью данных и вычислительной мощности привело к значительным успехам в решении различных проблем, таких как распознавание речи, классификация изображений, автономные транспортные средства, машинный перевод, роботизированное передвижение [на ногах] и вопросно-ответные системы.

По мере того как возможности этих и других областей переступают порог лабораторий и переходят к экономически значимым технологиям, общий круг привлекает большие инвестиции в исследования и привлечения даже незначительных улучшений. Есть общепринятое мнение, что исследования искусственного интеллекта прогрессируют постепенно, а их влияние на общество будет увеличиваться. Потенциальные выгоды огромны, поскольку все, что может предложить цивилизация — это продукт человеческого интеллекта; мы не можем предсказать, чего могли бы достичь, если бы этот интеллект был усовершенствован искусственным интеллектом, но в таком контексте искоренение бедности и болезней не являются непостижимыми целями. Из-за мощнейшего потенциала ИИ, очень важно исследовать, как получить его преимущества, избежав потенциальных ловушек».

Письмо обращается ко всем возможным проблемам, которые находятся на стыке искусственного и естественного интеллекта: как предупредить появление автоматического оружия, которое может убивать без разбора; кого винить в том, что автоматический транспорт теряет контроль над управлением и т. п.

Прочитать полную версию (на английском) или поискать себя в списках подписавшихся можно здесь.

Новости, статьи и анонсы публикаций

Чат с читателямиСвободное общение и обсуждение материалов