Идея того, что компьютер может обладать сознанием, все больше и больше тревожит людей. Кажется неестественным, что человекоподобная машина может чувствовать боль, понимать глубину сожаления или испытывать неземное чувство надежды. Однако некоторые эксперты утверждают, что именно этот тип искусственного интеллекта нам необходим, если мы хотим подавить угрозу существованию человека в зародыше, чем эта технология, безусловно, может стать в дальнейшем.

Выступая на днях в Кембридже Мюррей Шанахан, профессор когнитивной робототехники из Имперского колледжа Лондона, заявил, что для того, чтобы свести на нет угрозу «ИИ человеческого уровня» — или общего искусственного интеллекта (ОИИ), — он должен быть «человекоподобным».

Шанахан предположил, что если силы, которые движут нас к разработке ИИ человеческого уровня, остановить нельзя, есть два варианта. Либо будет разработан потенциально опасный ОИИ, в основе которого будет процесс безжалостной оптимизации без каких-либо намеков на нравственность, либо ОИИ будет разработан на основе психологического или, возможно, неврологического слепка человека.

«Прямо сейчас я бы отдал свой голос за второй вариант, в надежде, что это приведет к форме гармоничного сосуществования (с человечеством)», — сказал Шанахан.

Конец человеческой гонки

Вместе со Стивеном Хокингом и Элоном Маском, Шанахан консультировал Центр по изучению глобальных рисков (CSER) по составлению открытого письма, которое призывало исследователей ИИ обратить внимание на «подводные камни» в развитии искусственного интеллекта.

По мнению Маска, эти ловушки могут быть более опасными, чем ядерное оружие, тогда как Хокинг и вовсе считает, что они могут привести к концу человеческой эпохи.

«Примитивные формы искусственного интеллекта у нас уже есть, и они зарекомендовали себя очень хорошо, — говорил Хокинг в декабре 2014 года. — Но я думаю, что развитие полноценного искусственного интеллекта может означать конец для человеческой расы».

Кадр из фильма Ex machina, который выйдет в прокат весной 2015 года

Как вы знаете, не совсем непонятно, как далеки мы от разработки ОИИ — прогнозы варьируются от 15 до 100 лет с нынешнего момента. Шанахан считает, что 2100 год для ОИИ станет «более вероятным, но до конца не определенным».

Так это или нет, вся опасность лежит в том, какие мотивы будут двигать разработку маршрута ОИИ.

Деньги могут стать «причиной риска»

Есть опасения, что нынешние социальные, экономические и политические факторы, ведущие нас к ИИ человекоподобного уровня, приведут нас к первому варианту из двух, предложенных Шанаханом.

«Капиталистические силы приводят в действие безжалостные процессы максимизации. И это при соблазне разрабатывать рискованные вещи», — заявил Шанахан, приводя в пример компанию или государство, которая могла бы использовать ОИИ для подрыва рынков, фальсификации выборов или создания новых автоматизированных и потенциально неконтролируемых военных технологий.

«Военная промышленность будет делать это также, как и другие, поэтому этот процесс очень трудно остановить».

Несмотря на эти опасности, Шанахан считает, что было бы преждевременным запретить исследования ИИ в любой форме, так как в настоящее время нет оснований полагать, что мы можем на самом деле достичь этой точки. Вместо этого есть смысл направить исследования в нужном направлении.

Имитация ума для создания гомеостаза

ОИИ, сосредоточенный исключительно на оптимизации, не обязательно будет вредоносным по отношению к людям. Тем не менее тот факт, что он может поставить обзавестись инструментальной целью вроде самосохранения или заполучения ресурсов, может представлять значительный риск.

Как указывал в 2008 году теоретик искусственного интеллекта Элиэзер Юдковский, «ИИ не ненавидит нас и не любит, но вы сделаны из атомов, которые он может использовать для чего-то еще».

Создав некую форму гомеостаза в ОИИ, по мнению Шанахана, потенциал ИИ можно реализовать без разрушения цивилизации, какой мы ее знаем. Для ОИИ это была бы возможность понять мир так же, как человек, в том числе заполучить способность узнавать других, образовывать отношения, сообщаться и сочувствовать.

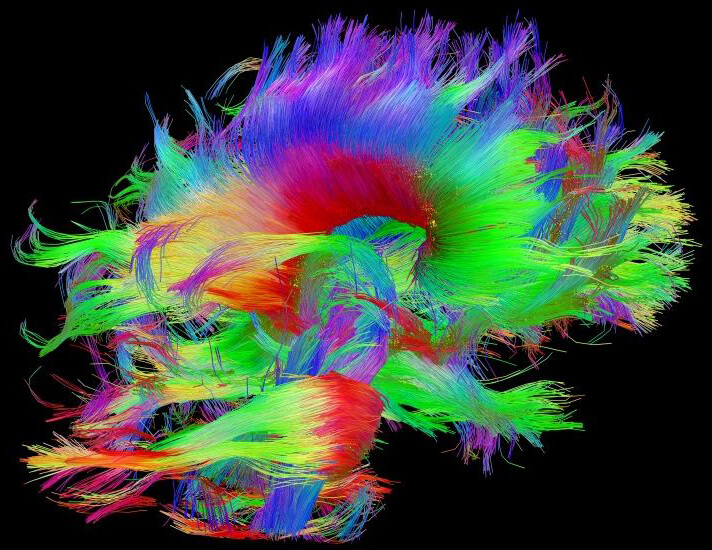

Один из способов создания человекоподобной машины — имитация работы человеческого мозга в его строении, а мы «знаем, как человеческий мозг может этого достичь». Ученые в двух шагах от составления полной карты мозга, не говоря уж о репликации его.

Human Connectome Project в настоящее время работает над обратным повторением мозга и завершит работу к третьему кварталу 2015 года, хотя анализ собранных данных будет продолжаться и долго после 2015 года.

«Наш проект будет иметь далеко идущие последствия для развития искусственного интеллекта, он является частью многих усилий, которые стремятся понять, как структурно организован мозг и как различные регионы работают совместно в разных ситуациях и выполняя разные задачи», — рассказала Дженнифер Элам из HCP.

«До сегодняшнего дня не было много связи между картированием мозга и искусственным интеллектом, в основном потому, что два этих поля подходили к проблеме понимания мозга с разных сторон и на различных уровнях. Поскольку анализ данных HCP продолжается, вполне вероятно, что некоторые моделлеры мозга включат свои находки в максимально возможной степени в свои вычислительные структуры и алгоритмы».

Даже если этот проект окажется полезным в оказании помощи исследователям ИИ, еще предстоит увидеть, на что способны другие инициативы вроде Human Brain Projects. Все это предоставит важную основу для разработки человекоподобной машины.

Сейчас, как говорит Шанахан, мы должны быть по крайней мере в курсе опасности, которую представляет развитие ИИ, не уделяя особого внимания голливудским фильмам или страшилкам в СМИ, что еще больше запутывает вопрос.

«Мы должны думать об этих рисках и посвятить некоторые ресурсы решению этих вопросов, — говорит Шанахан. — Надеюсь, нам хватит десятилетий, чтобы преодолеть эти барьеры».

Новости, статьи и анонсы публикаций

Чат с читателямиСвободное общение и обсуждение материалов